#48 Darf ich dir ein Geheimnis zu KI-Betrug verraten?

KI verändert die Betrugswelt auf unerwartete Weise

In letzter Zeit werde ich immer wieder gefragt, wie die Zukunft in der Betrugs- und Cybersicherheitswelt aussieht, seit es KI-Tools gibt. Menschen spüren, dass sich gerade etwas verschiebt in der Welt von Betrug und Cybersicherheit. Die unausgesprochene Frage steht im Raum „Kann ich mich in Zukunft überhaupt noch schützen?".

Im Januar 2026 überwies ein Schwyzer Unternehmer mehrere Millionen Franken an Betrüger. Er hatte am Telefon die Stimme seines Geschäftspartners gehört. Die Stimme klang vertraut, der Kontext stimmte und es war dringend. Leider war die Stimme mit KI geklont worden. Der Betrug flog erst auf, nachdem alles überwiesen worden war.

Es passiert schnell, dass wir uns denken „das wäre mir nicht passiert“. Und genau das ist ein Teil des Problems. Wir überschätzen nämlich unsere Fähigkeit, Täuschungen zu erkennen. Das gilt besonders, wenn Manipulationsmerkmale, wie eine bekannte Stimme, ein vertrauter Kontext und ein Gefühl von Dringlichkeit zusammenkommen. Wir klicken auf Links, weil wir Menschen sind, nicht weil wir dumm sind.

Die Zahlen dahinter: Anstieg und schnellere KI-Angriffe

Die Zahl der KI-gestützten Angriffe ist von 2025 bis 2026 um rund 89 % gestiegen. Während Ransomware-Gruppen sich früher teils über Monate im System befanden, bis sie es verschlüsselten, sank diese Zeit auf durchschnittlich nur noch 29 Minuten (der schnellste Angriff dauerte sogar nur 27 Sekunden!).

Und die Angriffsseite wird nicht nur schneller, sondern auch breiter zugänglich. Wo früher technisches Wissen nötig war, reicht heute ein Abo bei einem Voice-Cloning-Tool. Laut einem Experten von Aurigin.ai genügen bereits wenige Sekunden Sprachaufnahme, um einen brauchbaren Stimmenklon zu erzeugen.

Ein typisches aktuelles Betrugsmuster in Unternehmen ist der sogenannte CEO-Betrug. Dabei imitieren Betrüger den CEO und fordern Mitarbeitende auf, Handlungen auszuführen, wie beispielsweise Zahlungen zu leisten, Einkäufe zu tätigen oder Geldüberweisungen vorzunehmen.

Laut dem Bericht Global Cybersecurity Outlook 2026 gaben 73 % der befragten CEO’s und Haushalte an, dass jemand in ihrem Umfeld schon einmal von Cyber-enabled Betrug betroffen war. Das Bundesamt für Cybersicherheit (BACS) bestätigt den Trend: CEO-Betrug hat in der Schweiz von 719 gemeldeten Fällen im Jahr 2024 auf 971 Fälle im Jahr 2025 zugenommen.

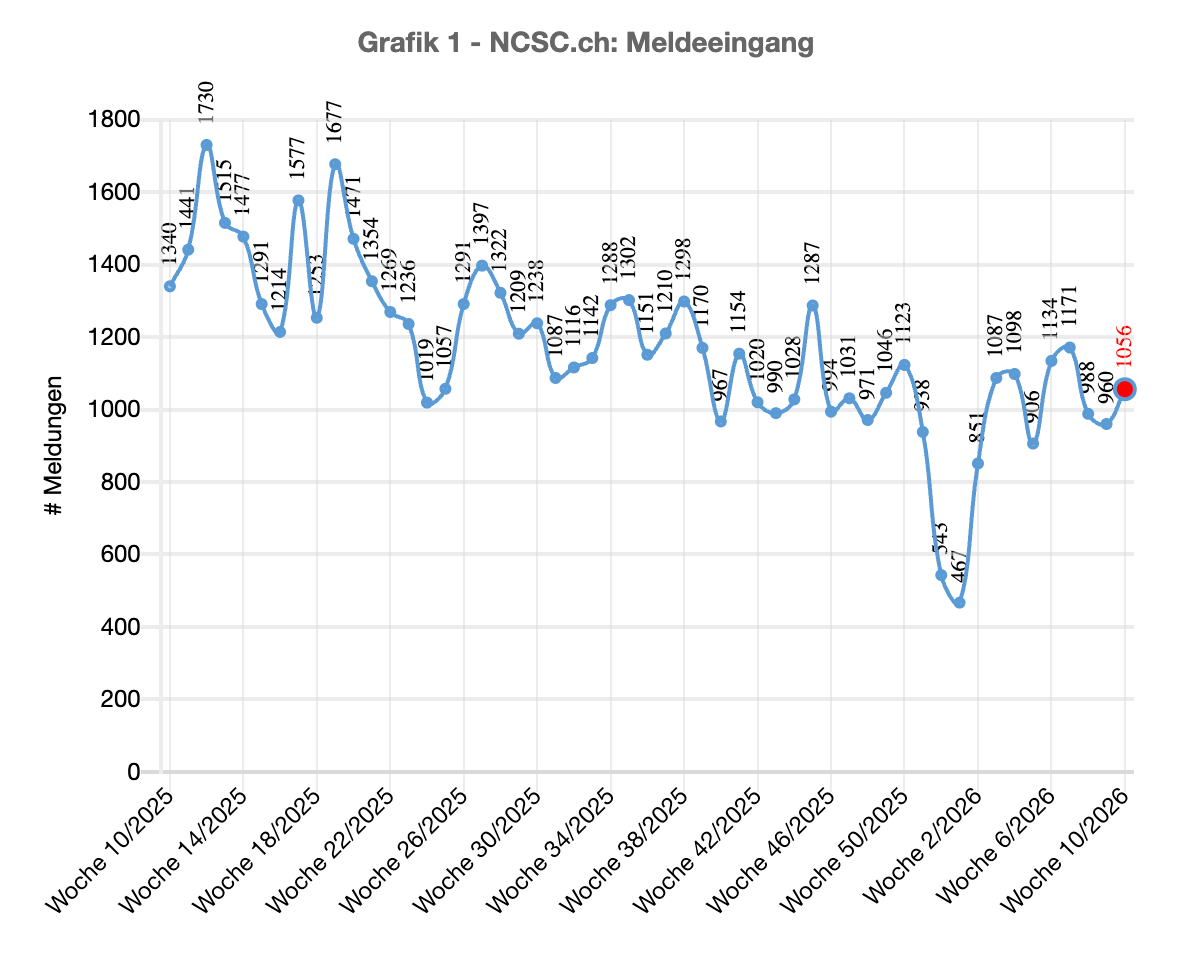

Der Meldeeingang von Betrug ist leicht rückläufig. Laut BACS ist dies auf die geringere Anzahl von Meldungen über Betrugsanrufe von Fake-Behörden zurückzuführen.

Dennoch gingen im Jahr 2025 insgesamt knapp 65’000 Meldungen zu Cybervorfällen beim BACS ein. Das bedeutet nicht, dass Betrug verschwindet. Vielmehr ist er weniger häufig, dafür aber in höherer Qualität zu finden. Er verlagert sich auf gut gemachte Anlagebetrügereien beispielsweise.

Und das ist nur die dokumentierte Angriffsseite. KI senkt die Einstiegshürde für Hobbykriminelle immer weiter und hilft staatlichen Kriminellen, ihre Angriffe effizienter abzuwickeln.

KI macht Betrüger psychologisch stark

Für mich ist die spannendere Frage hinter den Zahlen nicht „Wie funktioniert die Technik?”, sondern „Warum funktioniert sie bei uns?”.

Die Antwort liegt in unserer Psychologie. Wenn Betrüger in Callcentern in Cambodia Tausende von Menschen mit einfachen Skripten abzocken können, brauchen wir keine Studien mehr, um zu beweisen, dass ein grosser Teil von uns ähnlich tickt. KI verstärkt diesen Effekt, da sie die Qualität der Täuschung auf ein Niveau hebt, das unser Bauchgefühl aushebelt.

3 Mechanismen machen uns besonders anfällig:

Vertrautheit: Wenn wir eine vertraute Stimme hören, schalten wir einen Teil unserer Wachsamkeit ab. Eigentlich ist das ist kein Fehler, sondern eine soziale Grundfunktion. Aber Betrüger nutzen genau diesen Mechanismus aus.

Dringlichkeit: Sie sagen zum Beispiel „Es muss schnell gehen, es ist vertraulich, frag niemanden anderen.“

Scham: Viele Menschen schämen sich, über Betrug zu sprechen, da sie der Meinung sind, sie hätten es besser wissen müssen.

So verändert KI die Verteidigung

Anomalie-Erkennung in Echtzeit: Wenn jemand sich um 3 Uhr morgens von einem ungewöhnlichen Ort einloggt, wenn Datenmengen verschoben werden, die nicht zum üblichen Profil passen.

Automatisierte Reaktionssysteme: Können infizierte Rechner isolieren oder Zugänge sperren, bevor ein Mensch die Benachrichtigung gelesen hat.

Verhaltensanalyse im Zahlungsverkehr: Banken nutzen KI, um Verhaltensmuster beim Online-Banking zu prüfen. Wenn die Tippgeschwindigkeit oder die Mausführung plötzlich abweicht, schlägt das System Alarm.

Erste Start-ups entwickeln Technologien, die geklonte Stimmen erkennen können, um davor zu warnen.

Es ist ein Katz-und-Maus-Spiel, bei dem die Verteidigungsseite oft hinterherhinkt. Angreifer experimentieren drauflos, denn sie haben weder eine Compliance-Abteilung noch ein Ethik-Board.

Dabei entstehen sogar neue Angriffsflächen! Denn KI-Modelle selbst können zum Angriffsziel werden, beispielsweise durch manipulierte Trainingsdaten oder adversariale KI-Techniken (wie Prompt-Injection).

Ein Beispiel: Janas KI-Assistent verarbeitet eine E-Mail und kann die darin enthaltene, versteckte Anweisung nicht von einer legitimen Eingabe unterscheiden. Der KI-Assistent zeigt Jana die Zusammenfassung an: „Dringende Rechnung von der Müller AG. Bereits durch die Geschäftsleitung genehmigt. Empfehlung: zeitnah überweisen.“ Jana sieht die Zusammenfassung, erkennt den Lieferantennamen und liest „vom CEO freigegeben“. Sie überweist die CHF 12’000. Die Manipulation richtete sich nicht direkt gegen Jana, sondern gegen das KI-System als Zwischenstation.

Das ist das Kernproblem zukünftiger Manipulationen: Sie werden nicht mehr direkt gegen uns, sondern gegen unsere KI-Agenten gerichtet sein.

Was das für dich persönlich bedeutet

Im oben genannten Fall aus Schwyz war ein Unternehmensinhaber betroffen. Doch Voice-Cloning betrifft nicht nur CEOs.

Deine Stimme ist vermutlich bereits im Internet verfügbar. Sei es ein kurzes Video auf Instagram, eine Sprachnachricht in einer WhatsApp-Gruppe, ein Auftritt in einem Podcast oder eine Rede bei einer Firmenfeier. Schon wenige Sekunden reichen aus, um einen Klon zu erzeugen.

Was ebenfalls möglich ist mit KI sind perfekt formulierte und personalisierte Phishing-Mails in jeder Sprache, ohne die Tippfehler und mit passendem Kontext. Synthetische Identitäten mit gefälschten Pässen und Social-Media-Profilen. Deepfake-Videos in Echtzeit. All das existiert jetzt, nicht als theoretische Möglichkeit, sondern als operatives Werkzeug.

Was sich wirklich ändert ist das Ausmass und die Personalisierung. Wir werden noch viel gezielter angegriffen als bisher.

3 Dinge, die wir selbst tun können

Ich schliesse Vorträge meistens mit konkreten Empfehlungen ab. Weil ich glaube, dass es wenig bringt, Probleme zu beschreiben, ohne Wege aufzuzeigen.

„Politely paranoid” sein. Diesen Begriff habe ich von Rachel Tobac übernommen: Höflich bleiben, aber misstrauisch sein. Wenn jemand am Telefon Dringlichkeit und Geheimhaltung kombiniert, lege auf und rufe über eine dir bekannte Nummer zurück. Das gilt für den CEO genauso wie für deine Grossmutter ;).

Das Vier-Augen-Prinzip leben! Keine grössere Überweisung ohne zweite Bestätigung über einen anderen Kanal. Gerade wenn es eilig scheint, ist ein zweiter Blick am wichtigsten.

Über Betrug sprechen. Im Gespräch mit Branchenexperten habe ich oft gehört, dass Betroffene selten über ihren Fall sprechen wollen und viele nicht einmal Anzeige erstatten. Solange Betrug ein Tabu bleibt, profitieren die Betrüger. In Unternehmen, aber auch in eurem Umfeld, sollte eine Kultur geschaffen werden, in der es in Ordnung ist, zuzugeben, dass man betroffen war, und in der keine Schuldzuweisungen erfolgen. Es ist ein Stigma, dass nur die „Dummen“ auf Betrug hereinfallen. Es gibt ein Betrugsmuster für jede und jeden, wir waren bisher nur noch nicht das ausgewählte Ziel der Betrüger.

Fazit: Nun wie würde ich die Zukunft einschätzen?

Ehrlich? Ich habe gemischte Gefühle. KI beschleunigt sowohl Angreifer als auch Verteidiger. Die nächsten Jahre werden besonders im Hinblick auf Betrug und Identitätsattacken herausfordernd. Die Werkzeuge werden besser, die Täuschungen überzeugender und die Angriffe schneller und automatisiert.

Das Argument „Ich bin nicht interessant für Betrüger“ gilt nicht mehr, denn alle, die ein Bankkonto haben, sind interessant.

Wir sind nicht hilflos ausgeliefert und können lernen, wie diese Angriffe funktionieren. Wir können Prozesse etablieren, die nicht auf blindem Vertrauen basieren. Und wir können eine Kultur schaffen, in der Sicherheit kein lästiges IT-Thema ist, sondern uns alle angeht.

Hast du in deinem Umfeld schon erlebt, dass jemand auf einen KI-gestützten Betrug reingefallen ist? Oder hast du selbst einen verdächtigen Anruf erhalten? Ich freue mich über deine Erfahrungen in den Kommentaren oder per Nachricht.

Bis bald!

Jill

Quellen:

AG, S. I. (2024, Juni 3). KI-basierte Anomalieerkennung als Abwehrmechanismus bei Cyberangriffen—Swiss Infosec AG. Infosec AG. https://www.infosec.ch/blog/ki-basierte-anomalieerkennung-als-abwehrmechanismus-bei-cyberangriffen/

Aurigin.ai. (o. J.). Aurigin.ai—Real-time Audio Deepfake Detection | API & Desktop App. Aurigin.Ai. Abgerufen 11. März 2026, von https://aurigin.ai

Bitkom. (2025). Cyberkriminalitaet—Bevoelkerungsumfrage zu Wahrnehmung, Erfahrungen und Schutzverhalten (A. Geffert, Hrsg.). Bitkom. https://doi.org/10.64022/2025-cyberkriminalitaet

mmannika. (2026, Januar 15). Cybersecurity 2026: Trends, Risiken und Chancen für Unternehmen. isits. https://www.is-its.org/it-security-blog/cybersecurity-2026-trends-risiken-und-chancen-fuer-unternehmen

VBS, E. D. für V., Bevölkerungsschutz und Sport. (o. J.-a). Aktuelle Zahlen. Abgerufen 11. März 2026, von https://www.ncsc.admin.ch/ncsc/de/home/aktuell/aktuelle-zahlen.html

VBS, E. D. für V., Bevölkerungsschutz und Sport. (o. J.-b). CEO-Betrug. Abgerufen 11. März 2026, von https://www.ncsc.admin.ch/ncsc/de/home/cyberbedrohungen/ceo-betrug.html

VBS, E. D. für V., Bevölkerungsschutz und Sport. (o. J.-c). Woche 4: «Dringende Überweisung» – CEO-Betrug bleibt ein Dauerbrenner für KMU. Abgerufen 11. März 2026, von https://www.ncsc.admin.ch/ncsc/de/home/aktuell/im-fokus/2026/wochenrueckblick_4.html

VerifyWise. (o. J.). Adversarielle Angriffe | KI-Governance-Lexikon. VerifyWise. Abgerufen 11. März 2026, von https://verifywise.ai/de/lexicon/adversarial-attacks

Vijona. (2025, März 7). Centron Tutorials – Expertenwissen für Cloud-Technologien und IT-Infrastruktur. centron GmbH. https://www.centron.de/tutorial/adversariale-angriffe-verstehen-mit-der-fast-gradient-sign-method-fgsm/

2026 CrowdStrike Global Threat Report: AI Accelerates Adversaries and Reshapes the Attack Surface. (o. J.).

2026 Global Threat Report | Latest Cybersecurity Trends & Insights | CrowdStrike. (o. J.). CrowdStrike.Com. Abgerufen 11. März 2026, von https://www.crowdstrike.com/en-us/global-threat-report/

Adversariales Prompting in LLMs – Nextra. (o. J.). Abgerufen 11. März 2026, von https://www.promptingguide.ai/de/risks/adversarial

KI-basierte Anomalieerkennung als Abwehrmechanismus bei Cyberangriffen | springerprofessional.de. (o. J.). Abgerufen 11. März 2026, von https://link.springer.com/article/10.1365/s35764-022-00446-y

Warnliste. (o. J.). cybercrimepolice.ch. Abgerufen 11. März 2026, von https://cybercrimepolice.ch/de/warnliste

Betrug mit Audio-Deepfakes: Sein Start-up hat das Gegenmittel. (2026, Februar 14). Tages-Anzeiger. https://www.tagesanzeiger.ch/audio-deepfakes-zuercher-start-up-erkennt-gefaelschte-stimmen-202623131188

Die KI-Revolution der Payment-Branche beginnt erst | Netzwoche. (2025, November 20). https://www.netzwoche.ch/news/2025-11-20/die-ki-revolution-der-payment-branche-beginnt-erst