#44 Die häufigsten Denkfehler & Biases

Warum unser Gehirn uns manchmal austrickst

Wir halten uns oft für rationale Denker, doch unser Gehirn nutzt Abkürzungen (Heuristiken), die uns in die Irre führen können. In diesem Artikel sind „Denkfallen” und Denkeffekte aufgeführt, die dabei helfen können, ein besseres Verständnis für menschliches Handeln zu entwickeln.

In diesem Artikel:

Entscheidungs-Mindset und unser Denksystem

Denkfehler und -Effekte

Strategien zum Umgang damit

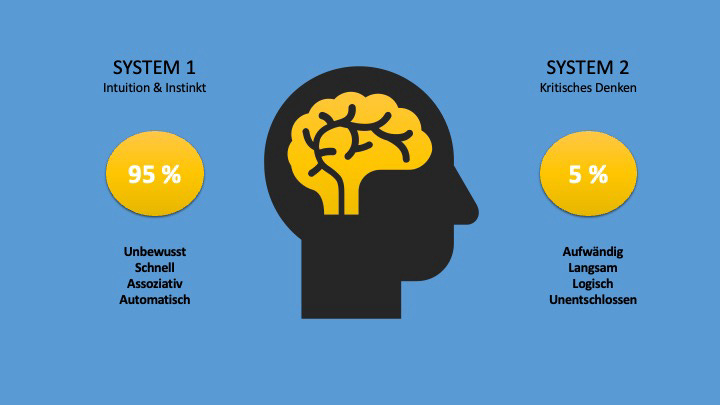

Die Stärke des menschlichen Denkens liegt im Zusammenspiel von zwei Denksystemen. System 1 und System 2. System 1 ermöglicht schnelles, automatisches und intuitives Denken, das auf Erfahrung und erlernten Mustern basiert (95%). Dadurch können Menschen blitzschnell Entscheidungen treffen und auf Gefahren oder alltägliche Situationen reagieren, ohne dabei grosse mentale Ressourcen zu beanspruchen. Diese Fähigkeit ist evolutionär sinnvoll. Es hat uns bisher das Überleben gesichert und entlastet das Gehirn. Mit System 2 (5%) sind wir in der Lage, bewusst zu reflektieren, Fehler zu korrigieren und neue Strategien zu entwickeln.

Die Kombination beider Systeme ermöglicht Effizienz. Während System 1 für Intuition und schnelles Reagieren sorgt, ermöglicht System 2 zielgerichtetes, bewussteres Nachdenken. So können Menschen schnell handeln, ohne ständig alle Details bewusst zu verarbeiten, und bei Bedarf dennoch tiefgründig und rational Entscheidungen treffen.

Das System 1 verlässt sich auf sogenannte Heuristiken, damit es so effizient arbeiten kann. Heuristiken sind mentale Abkürzungen bzw. Faustregeln, mithilfe derer unser Gehirn schnell und effizient Entscheidungen treffen kann, ohne jedes Detail analysieren zu müssen. Ein Beispiel für eine Heuristik ist: „Was mir schnell einfällt, muss stimmen“ (z. B. Flugangst nach einem Absturzbericht).

Heuristiken sind an sich nicht schlecht oder falsch, sondern nützliche mentale Werkzeuge. Werden sie jedoch in der falschen Situation angewendet oder führen zu starker Vereinfachung, entstehen daraus Biases (Denkfehler), die zu fehlerhaften Urteilen führen.

Wie viel Analyse ist genug? 2 unterschiedlichen Entscheidungsstrategien

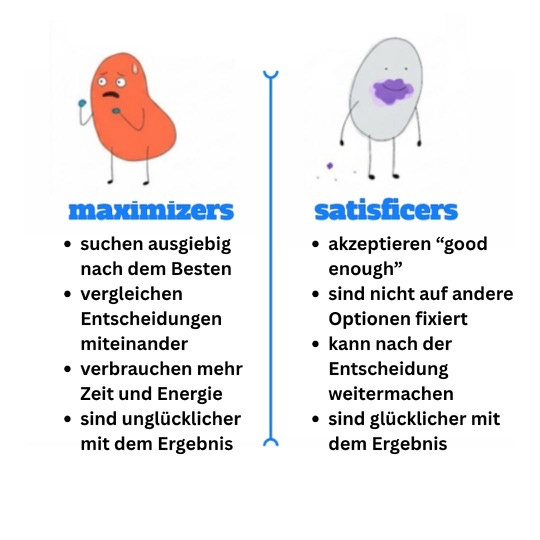

Die Frage, wie stark wir auf Heuristiken setzen oder in die Tiefe gehen sollten, führt zu unterschiedlichen Entscheidungsstrategien. Menschen neigen hierbei zu zwei grundlegenden Ansätzen: dem Satisficer- und dem Maximizer-Mindset. Satisficer wählen die Option, die „gut genug“ ist und die Mindestanforderungen erfüllt („Diese Kopfhörer haben gute Bewertungen und passen ins Budget – gekauft!“). Maximizer hingegen streben nach der besten Wahl und verzögern deshalb auch gerne einmal eine Entscheidung, um das Optimum herauszuholen („Ich habe 47 Tabs mit verschiedenen Kopfhörern geöffnet. Welche sind DIE besten für den Preis?”).

„Theoretisch wäre die perfekte Mischung, sich die meiste Zeit mit einem zufriedenstellenden Ergebnis zu begnügen und den Entscheidungsprozess nur dann zu maximieren, wenn viel auf dem Spiel steht“, sagt Preston im BBC-Artikel dazu, welches Mindset die besten Entscheidungen trifft. Und wahrscheinlich lohnt sich dieser hybride Ansatz auch, denn Forschungen zeigen, dass Maximizer trotz ihres Strebens nach dem besten Ergebnis oft weniger glücklich sind als Satisficer.

Unabhängig davon, ob wir maximieren oder satisficen, bleibt unser Denken anfällig für systematische Fehler. Davon gibt es deutlich mehr, als wir bisher besprochen haben. Der Cognitive Bias Codex bietet einen Überblick über mehr als 180 verschiedene kognitive Verzerrungen und ordnet sie vier Hauptkategorien zu. Dazu gehören, was wir uns merken, wie viel Information zu viel ist, was Dinge bedeuten und was wir schnell tun müssen. Diese Visualisierung macht das Ausmass unserer mentalen Schwachstellen sichtbar:

Im folgenden Teil werde ich auf ausgewählte kognitive Verzerrungen und Effekte eingehen, die es sich besonders zu kennen lohnt.

Biases und Denkfehler

Confirmation Bias (Bestätigungsfehler): „Endlich schreibt’s mal einer! Dieser Artikel beweist genau das, was ich schon immer gesagt habe.“

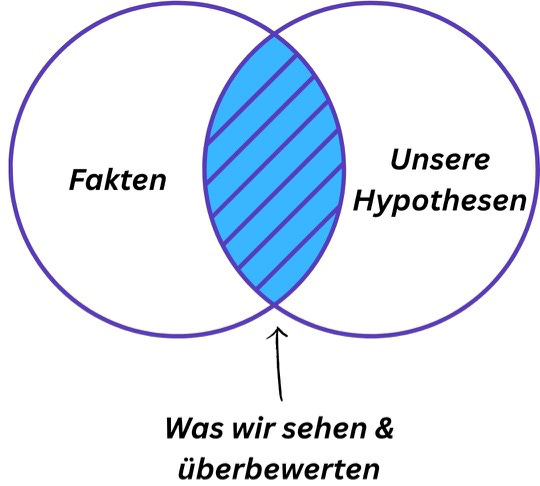

Wir suchen und interpretieren Informationen so, dass sie unsere bereits bestehenden Überzeugungen bestätigen, während wir widersprechende Beweise ignorieren. Confirmation Bias ist ein bisschen wie Horoskope lesen:

Wenn man die Sternzeichen löscht, könnte jeder Text irgendwie zu uns passen.

Halo-Effekt: „Sie ist so attraktiv und gut gekleidet, sie muss auch kompetent und vertrauenswürdig sein.“ Ein einzelnes positives Merkmal (z.B. Attraktivität) kann alle anderen Eigenschaften einer Person überstrahlen und unser Gesamturteil beeinflussen.

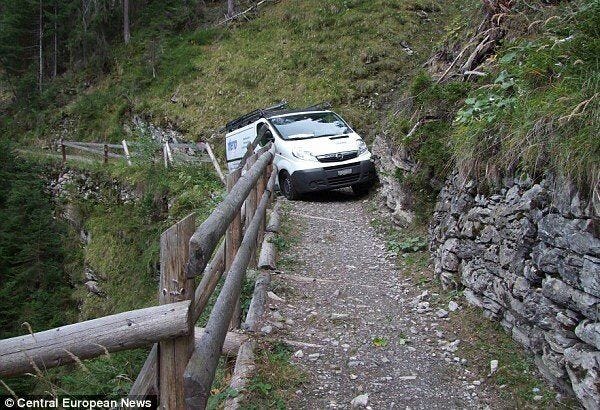

Automation Bias: „Das GPS weiss am besten, wo es hingeht.“

Wir vertrauen blind den Ergebnissen von Computersystemen und Tools, ohne sie kritisch zu hinterfragen oder zu überprüfen.

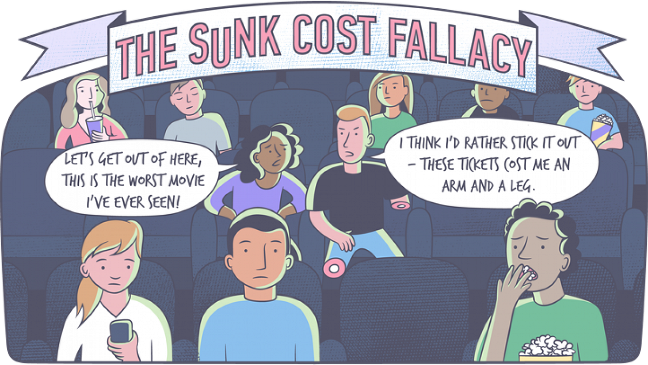

Sunk Cost Fallacy (Versunkene-Kosten-Falle): „Ich habe schon drei Jahre in diese Beziehung bzw. dieses Studium investiert, jetzt kann ich nicht mehr aufhören.“ Wir setzen ein Projekt fort, nur weil wir bereits Zeit, Geld oder Energie investiert haben, obwohl ein Abbruch sinnvoller wäre.

Loss Aversion (Verlustaversion): „Ich verkaufe die Aktie nicht, sondern warte lieber, bis ich wieder bei null bin, bevor ich mit Verlust aussteige.“ Verluste schmerzen uns psychologisch etwa doppelt so stark wie Gewinne uns erfreuen, was zu risikoaversen Entscheidungen führt.

Dunning-Kruger-Effekt: Menschen mit geringen Kenntnissen überschätzen ihre Kompetenz massiv, während Experten ihr Wissen eher unterschätzen.

Die Hierarchie der Kompetenzen zeigt vier Lernphasen: Zunächst sind wir uns unserer Unfähigkeit nicht bewusst, weshalb wir uns häufig überschätzen. Danach folgt die bewusste Inkompetenz, dann die bewusste Kompetenz und schließlich die unbewusste Kompetenz, bei der wir ohne Nachdenken intuitiv handeln können.

Ein eindrückliches Beispiel hierfür ist ein Fahrrad-Experiment. Probanden sollten ein Fahrrad aus dem Gedächtnis zeichnen. Die meisten waren davon überzeugt, dazu in der Lage zu sein. („You think it’s simple, but it’s not!“) Das Ergebnis waren teils unmögliche Konstruktionen mit Ketten an falschen Stellen und absurder Mechanik.

Weitere Biases:

Verfügbarkeitsheuristik: „Nach diesem Flugzeugabsturz in den Nachrichten fahre ich lieber mit dem Auto, denn das ist sicherer.“ Wir halten Ereignisse für wahrscheinlicher, wenn wir uns leicht an Beispiele erinnern können (z.B. überschätzen wir nach Medienbericht das Risiko von Flugzeugabstürzen).

Anchoring Bias (Anker-Effekt): “Der Autohändler wollte 20K, ich habe ihn auf 16K runtergehandelt, ein super Schnäppchen!” (Wert effektiv 14K). Die erste Information, die wir erhalten, dient als mentaler “Anker” und beeinflusst alle folgenden Einschätzungen unverhältnismässig stark.

Hindsight Bias (Rückschaufehler): „Dass die Firma pleitegeht, war doch von Anfang an klar. Das hätte jeder sehen können!“ Im Nachhinein erscheinen uns vergangene Ereignisse vorhersehbarer, als sie tatsächlich waren.

Groupthink (Gruppendenken): „Alle nicken zustimmend ... Ich habe zwar Bedenken, aber ich sage lieber nichts.“ In Gruppen unterdrücken wir kritische Meinungen zugunsten von Harmonie und Konsens, was zu schlechten Entscheidungen führt.

Bandwagon Effect (Mitläufereffekt): „Alle meine Freunde investieren jetzt in Kryptowährungen. Das muss also eine gute Idee sein.“ Wir übernehmen Meinungen oder Verhaltensweisen, nur weil viele andere das auch tun, unabhängig von ihrer Richtigkeit.

Bystander Effect (Zuschauereffekt): „Die Person braucht Hilfe, aber es stehen 20 Leute herum. Wenn es ernst wäre, hätte bestimmt schon jemand etwas unternommen”. Je mehr Menschen eine Notsituation beobachten, desto unwahrscheinlicher ist es, dass jemand eingreift. Dieser Effekt wurde beim Mord an Kitty Genovese beobachtet. 38 Zeugen unternahmen nichts, da sie annahmen, dass sicher schon jemand die Polizei gerufen habe.

IKEA-Effekt: “Mein Regal ist selbstgebaut. Es ist viel schöner als die gekauften.”

Wir überbewerten Dinge, die wir selbst erschaffen oder zusammengebaut haben, nur weil wir Arbeit hineingesteckt haben.

Illusory Truth Effect (Wahrheitsillusion): “Dieses Produkt ist krebserregend, es wird ja schon lange überall darüber berichtet”. Je häufiger wir eine Aussage hören oder lesen, desto wahrer erscheint sie uns.

Und noch ein letzter Bias, der euch im neuen Jahr helfen könnte Dinge zu verändern:

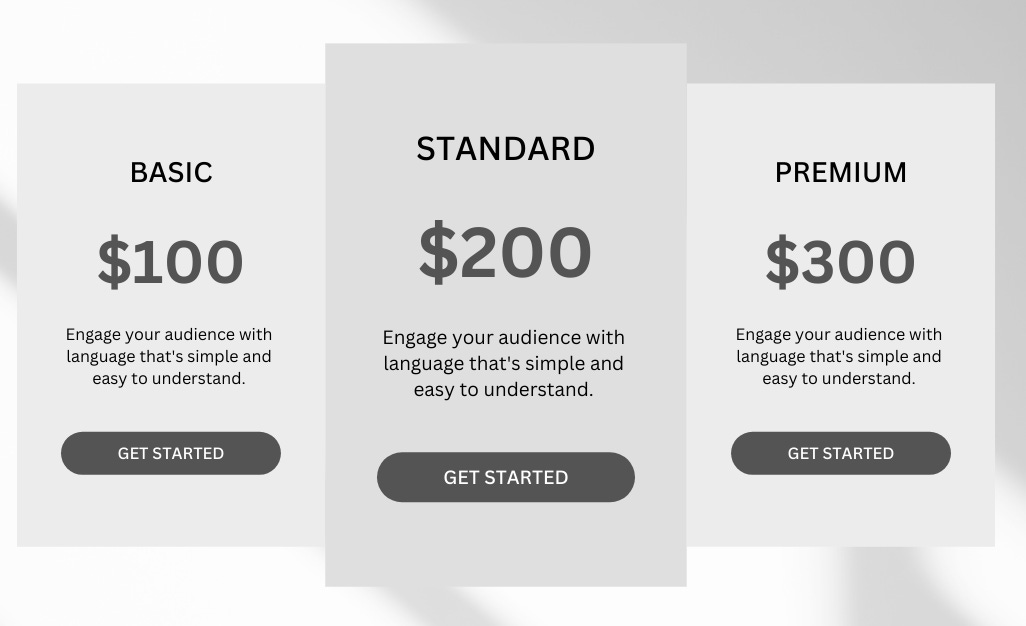

Status Quo Bias: „Wir haben das schon immer so gemacht. Warum sollten wir jetzt etwas ändern? Es funktioniert doch.“ Wir bevorzugen den gegenwärtigen Zustand und meiden Veränderungen, selbst wenn diese vorteilhaft wären. Ein klassisches Experiment von William Samuelson und Richard Zeckenhauser zeigte, dass Probanden eine Investitionsalternative deutlich bevorzugten, wenn diese als Status quo präsentiert wurde, obwohl es keine objektive Grundlage gab, diese Wahl zu präferieren. Für uns bedeutet das, wenn wir beispielsweise beim Kauf, oder Abschluss eines Vertrages einer Default-Option begegnen, könnte diese vom Verkäufer bewusst gewählt sein, um uns dazu zu bringen, die teurere Variante zu wählen.

Die Erkenntnis dieser Denkfallen kann uns dabei helfen, sie besser zu erkennen und bewusst zuzulassen. Wenn wir lernen, unsere automatischen Denkmuster zu erkennen und in entscheidenden Situationen das rationale Denken einzuschalten, können wir fundiertere Entscheidungen treffen.

Bis bald!

Jill

Quellen:

Cognitive_Bias_Codex_With_Definitions,_an_Extension_of_the_work_of_John_Manoogian_by_Brian_Morrissette.jpg (6779×6185)

Do „maximisers“ or „satisficers“ make better decisions? (2021, März 30). https://www.bbc.com/worklife/article/20210329-do-maximisers-or-satisficers-make-better-decisions

Heuristiken. (o. J.). Abgerufen 30. November 2025, von https://www.spektrum.de/lexikon/psychologie/heuristiken/6524

Satisficing. (2024). In Wikipedia. https://de.wikipedia.org/w/index.php?title=Satisficing&oldid=244656399

Thinking, Fast and Slow. (2025). In Wikipedia. https://en.wikipedia.org/w/index.php?title=Thinking,_Fast_and_Slow&oldid=1324644632